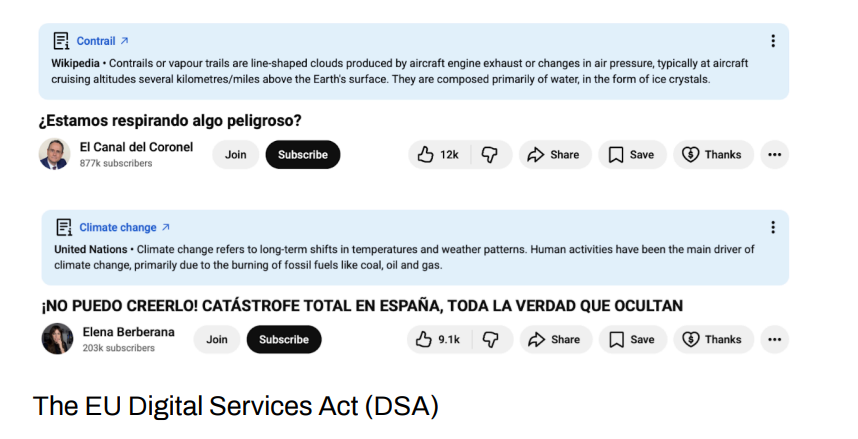

En un informe de la Fundación Maldita de marzo de 2026 se sostiene que YouTube está financiando “desinformación climática”, que incumple sus propias políticas, que desatiende las denuncias remitidas por la fundación y que, con ello, actúa “en contra de sus propias políticas y de la Ley de Servicios Digitales de la Unión Europea”. Para sostener esa tesis, Maldita afirma haber identificado 20 canales con más de 21 millones de suscriptores acumulados, vídeos con más de 3 millones de visualizaciones y 20 denuncias sin respuesta por parte de YouTube. Además, llega a calificar esa falta de respuesta como una “violación flagrante y sistemática” de la DSA.

No estamos ante un artículo divulgativo sobre cambio climático, sino ante una petición de endurecimiento de la moderación privada basada en una combinación de políticas internas de plataforma, lenguaje de “consenso científico”, referencias a riesgos sistémicos y alusiones directas al Derecho de la Unión. No es una mera crítica a YouTube sino una defensa de la restricción del discurso lícito por vía contractual, presentada bajo el prestigio simbólico de la ley.

La primera cuestión que conviene aclarar es jurídica. La DSA no convierte en ilegal cuestionar el cambio climático. El artículo 16 se refiere a mecanismos para notificar “contenidos ilícitos”, no contenidos erróneos, heterodoxos o simplemente opuestos al criterio editorial de una fundación. El reglamento exige que quien notifica explique por qué considera que una información es “contenido ilícito” y, además, solo atribuye conocimiento efectivo cuando un prestador diligente pueda apreciar la ilicitud “sin un examen jurídico detallado”.

Sin embargo, Maldita desplaza el centro del debate. En su informe no se limita a decir que YouTube no aplica bien su política comercial. Va más lejos. Afirma que el fallo de aplicación tiene consecuencias legales, que el artículo 34 obliga a la plataforma a tener en cuenta sus condiciones generales y su ejecución en la evaluación de riesgos sistémicos, y que, en ese sentido, los términos de YouTube no son voluntarios, sino uno de los criterios con los que se mide el cumplimiento de la DSA. También añade que la monetización de esos vídeos es contraria a los compromisos asumidos bajo el Código de Buenas Prácticas contra la Desinformación, al que presenta como referencia de cumplimiento de la DSA.

La crítica de fondo empieza ahí. Porque una cosa es sostener que si YouTube promete una política de desmonetización debe aplicarla con coherencia. Y otra muy distinta es convertir esa coherencia contractual en una especie de mandato cuasi legal para marginar contenidos que no han sido declarados ilícitos por ninguna norma. El artículo 14 de la DSA obliga a las plataformas a incluir en sus condiciones generales las restricciones que imponen y a aplicarlas “de manera diligente, objetiva y proporcionada”, teniendo en cuenta “los derechos fundamentales de los destinatarios del servicio, como la libertad de expresión, la libertad y el pluralismo de los medios de comunicación”. Es decir, la ley no bendice sin más cualquier política interna; la somete a un estándar de proporcionalidad y respeto a derechos fundamentales.

Ese matiz es decisivo y el informe de Maldita lo trata de forma claramente insuficiente. Porque si una plataforma generalista como YouTube no es un club privado temático, sino uno de los grandes espacios de discusión pública de nuestro tiempo, no basta con invocar sus normas internas como si fueran una fuente autónoma de legitimidad. En una plataforma de vídeos de fútbol tendría sentido excluir sistemáticamente conversaciones ajenas a ese objeto. Pero en un espacio generalista, donde se mezclan información, opinión, debate político, entretenimiento y controversia científica, la libertad de expresión no puede quedar reducida a lo que una empresa o una fundación consideren compatible con un concepto tan ambiguo como “consenso científico”.

Maldita habla de contenidos que contradicen el consenso científico bien establecido y presenta como desinformación vídeos que, según su metodología, se ajustan a narrativas previamente desmentidas por la propia organización, apoyándose en evidencia científica publicada y conocimiento experto. El problema no es negar que existan consensos científicos robustos. El problema es usar esa noción como criterio operativo para activar castigos de plataforma —desmonetización, reducción de alcance o presión para retirada— sin reconocer suficientemente que el término, fuera de contextos muy cerrados, tiene una indudable elasticidad epistemológica y política.

La ciencia funciona porque admite crítica, refutación, revisión y matización. Eso no significa que cualquier disparate merezca idéntica consideración intelectual. Significa que el error, incluso el error grave, no equivale automáticamente a una categoría sancionable por la arquitectura regulatoria europea. Una sociedad libre puede refutar una tesis absurda sin necesidad de convertirla en invisible por contrato.

El problema es quién se apropia de ese consenso, quién lo interpreta, quién lo convierte en criterio de castigo y con qué legitimidad una fundación privada. En la práctica esto pretende decir que salirse de él debe comportar sanciones económicas o algorítmicas.

Aquí aparece la censura indirecta. El DSA no ordena de forma general retirar opiniones climáticas disidentes, pero sí introduce un marco en el que las plataformas muy grandes deben evaluar riesgos sistémicos. El artículo 34 obliga a tener en cuenta, entre otros factores, los sistemas de recomendación, los sistemas de moderación de contenidos, las condiciones generales aplicables y su ejecución, así como los sistemas de selección y presentación de anuncios. Y el artículo 35 les exige aplicar medidas de reducción de riesgos “razonables, proporcionadas y efectivas”, adaptando incluso sus condiciones generales, sus procesos de moderación y su tratamiento de notificaciones, siempre “teniendo especialmente en cuenta las consecuencias de dichas medidas sobre los derechos fundamentales”.

Eso significa que la ley no prohíbe discrepar, pero sí puede empujar a que ese desacuerdo se trate como un problema a gestionar. Esta circunstancia puede acabar traduciéndose en menos visibilidad, menos ingresos o desgaste reputacional. El efecto en la práctica se acerca bastante a una limitación de la libertad de opinión, aunque nadie haya prohibido expresarse.

La cuestión de fondo no tanto una censura explícita, sino un cambio más sutil. El límite jurídico claro se diluye y lo sustituye una especie de sistema híbrido en el que instituciones, códigos de conducta, fundaciones y plataformas acaban influyendo en qué se ve y qué no, sin que ese filtro pase por un debate legal directo sobre lo que es lícito o no.

Sin embargo, Maldita da un paso más y endurece su planteamiento. En su informe sostiene que el artículo 34 obliga a YouTube a tener en cuenta sus propios términos y condiciones, así como su aplicación, a la hora de evaluar riesgos sistémicos, y subraya que esos términos no son voluntarios como criterio para medir el cumplimiento de la DSA. Además, vincula ese argumento con el Código de Buenas Prácticas contra la Desinformación, presentándolo como una referencia de cumplimiento regulatorio.

La operación es clara, convertir compromisos privados y códigos que en origen son voluntarios en una especie de estándar casi legal que sirva para justificar la desmonetización de discursos que se salen de la línea dominante.

En ese contexto, el papel de Maldita merece una crítica deontológica severa. No porque verifique contenidos ni porque sostenga una posición fuerte sobre la desinformación climática, sino porque intenta situarse a la vez como árbitro epistemológico, actor de incidencia pública y legitimador de medidas de plataforma. Y esa mezcla plantea un problema clásico de ética periodística. El Código Deontológico de la FAPE recuerda que el periodista no está obligado a ser neutral, pero sí debe distinguir claramente entre hechos y opiniones; debe fundamentar las informaciones, contrastar las fuentes y dar a la persona afectada la oportunidad de ofrecer su versión.

Además, el artículo 20 reconoce un sistema de reclamaciones internas frente a decisiones de plataforma, incluidas las relativas a no retirar contenido, bloquearlo, restringir su visibilidad o no hacerlo. Es decir, la DSA presupone que esas decisiones existen y que pueden discutirse, pero no consagra que una fundación privada tenga derecho a que su criterio editorial sea ejecutado como si fuera una orden jurídica. Lo que reconoce es un marco procedimental y de recurso, no una autoridad privada para decidir los límites de la conversación pública.

Lo que se está consolidando aquí es un mecanismo perfectamente elaborado para sortear, por vías privadas y regulatorias, las garantías que el ordenamiento europeo reconoce a la libertad de opinión, de expresión y al pluralismo informativo. Cuando una idea no puede prohibirse abiertamente sin chocar con los principios de la Unión, se la degrada, se la desmonetiza y se la expulsa de la conversación pública mediante una cadena cuidadosamente diseñada de normas ambiguas sobre “riesgos”, políticas internas de plataforma, códigos de conducta presentados como voluntarios y agencias de verificación que actúan como brazo ejecutor y legitimador del sistema. No estamos ante un simple combate contra la falsedad, sino ante una censura indirecta altamente sofisticada, construida precisamente para evitar el coste jurídico y político de vulnerar de frente los derechos fundamentales. Y en esa arquitectura, la disidencia —también la disidencia política— deja de ser refutada para empezar a ser administrada, castigada y empujada fuera del espacio público bajo apariencia de neutralidad técnica.

Maldita puede decir que combate la mentira. Puede incluso denunciar incoherencias de YouTube. Lo que no debería poder hacer sin crítica severa es usar el prestigio del Derecho europeo para presentar como casi obligatoria una lógica de moderación que, aplicada de manera expansiva, erosiona precisamente aquello el artículo 14 de la propia DSA supuestamente manda proteger ( aunque en la practica sea lo contrario), esto es, la libertad de expresión, la libertad y el pluralismo de los medios.

Fuente:

YouTube Lies_ How the Platform Finances… Own Policies and the DSA · Maldita

YouTube miente_ cómo la plataforma fina…ias políticas y de la DSA · Maldita

https://files.maldita.es/maldita/uploads/2026/03/69aefeed046e8.pdf