La Ley de Servicios Digitales (DSA) es presentada por la Unión Europea como una herramienta para modernizar la regulación del entorno digital, combatiendo la desinformación y garantizando un espacio más seguro en línea. Sin embargo, su aplicación ha generado fuertes críticas por su potencial para instaurar mecanismos de censura, especialmente en temas sensibles como la salud pública, las vacunas y las crisis geopolíticas. Si bien el objetivo declarado de la DSA es mejorar la seguridad de los ciudadanos y defender los valores democráticos europeos, la concentración de poder que otorga a las instituciones comunitarias y su estructura de control algorítmico han abierto un nuevo debate sobre sus efectos en la libertad de expresión y el pluralismo informativo.

En un mundo interconectado, la regulación del espacio digital es una necesidad evidente. La DSA, en vigor desde 2024 para todas las plataformas digitales que operan en la UE, establece una serie de obligaciones para proveedores de servicios en línea, motores de búsqueda, redes sociales y marketplaces. Las plataformas de muy gran tamaño (VLOPs), como Facebook, Google, YouTube o TikTok, están sujetas a requisitos particularmente exigentes: deben auditar sus sistemas, evaluar y mitigar riesgos sistémicos, cooperar con autoridades europeas y actuar contra contenidos ilegales o «nocivos» en plazos muy breves.

La ley incorpora también un mecanismo de crisis que, bajo la declaración de amenaza sanitaria, política o de seguridad, permite imponer medidas excepcionales en todo el ecosistema digital europeo. Este mecanismo, oficialmente denominado “procedimiento de respuesta ante crisis” dentro del marco de la DSA, otorga a la Comisión Europea poderes extraordinarios para intervenir de manera directa en la gestión del flujo de información en línea durante situaciones consideradas críticas. Entre estas se incluyen pandemias, como la del COVID-19, amenazas a la salud pública, conflictos armados o crisis de desinformación que puedan afectar a la estabilidad social o institucional de los Estados miembros. En dichos contextos, la Comisión puede exigir a las plataformas la eliminación acelerada de contenidos, la limitación del alcance de ciertas publicaciones, la priorización de fuentes “fiables” según criterios institucionales y la cooperación con actores públicos sin requerir necesariamente una supervisión judicial previa.

Lo alarmante no es solo el poder conferido, sino la vaguedad con la que se define lo que constituye una “crisis”. El texto legislativo no especifica umbrales claros ni criterios objetivos para activar este mecanismo, dejando el proceso a la discrecionalidad de la Comisión y a una interpretación abierta de lo que puede representar una amenaza “sistémica” o “inminente”. Además, la activación del mecanismo de crisis no requiere consenso del Parlamento Europeo ni una consulta previa a los ciudadanos o actores de la sociedad civil, lo que reduce los mecanismos de control democrático y aumenta el riesgo de abuso político.

Este dispositivo excepcional se asemeja a un estado de emergencia digital que puede afectar de forma transversal a plataformas sociales, buscadores, medios digitales y servicios de mensajería, permitiendo al Ejecutivo europeo moldear el discurso público durante momentos de alta tensión. Aunque se afirma que estas medidas serán temporales y estarán sujetas a salvaguardas, los antecedentes en la gestión de crisis recientes muestran que tales prerrogativas tienden a prolongarse y expandirse con el tiempo. En la práctica, se establece un precedente en el que las libertades civiles pueden ser restringidas no por decisión judicial, sino por decisión administrativa centralizada, generando un desequilibrio profundo entre seguridad institucional y derechos fundamentales.

Uno de los primeros campos de aplicación de la DSA ha sido la salud pública. En respuesta al aumento de casos de sarampión y a las bajas tasas de vacunación en Europa, la Comisión Europea ha intensificado las campañas para fomentar la inmunización. Sin embargo, en este contexto, ha comenzado también una cruzada regulatoria contra toda narrativa que cuestione la eficacia, seguridad o necesidad de las vacunas, especialmente las desarrolladas durante la pandemia de COVID-19. Cualquier información que se desvíe del discurso oficial se cataloga como “desinformación” o incluso como “peligrosa”. Se ha desplegado una red de instituciones, portales y campañas —como “Unidos en la Protección” o el Portal Europeo de Información sobre Vacunación— que no sólo buscan informar, sino también desplazar y marginar cualquier discurso alternativo.

La desconfianza ciudadana hacia las instituciones sanitarias, lejos de ser abordada mediante diálogo y transparencia, es interpretada como un obstáculo a eliminar. La promoción de las vacunas se ha vinculado incluso con otros programas políticos como la lucha contra el cáncer o la digitalización sanitaria, consolidando así un marco ideológico único. Esto convierte a la DSA en una herramienta de uniformización narrativa, donde el escepticismo o la crítica médica no son tolerados, ni siquiera como parte de un debate científico legítimo. Esta tendencia pone en cuestión el derecho fundamental de los ciudadanos a informarse desde múltiples fuentes y tomar decisiones libres y conscientes.

Uno de los efectos más alarmantes de la DSA es el que produce sobre las propias plataformas digitales. Obligadas a cumplir con extensos protocolos de vigilancia, supervisión de contenidos y cooperación con los llamados “denunciantes de confianza” (trusted flaggers), estas plataformas se ven forzadas a adoptar políticas de moderación cada vez más agresivas. La figura del denunciante de confianza es uno de los mecanismos centrales de la DSA para identificar y retirar contenidos supuestamente ilegales o dañinos. Se trata de personas u organizaciones previamente autorizadas por las autoridades competentes —generalmente agencias gubernamentales, organismos reguladores o actores de la sociedad civil vinculados al ámbito institucional— que, por su estatus, gozan de prioridad operativa: cuando presentan una denuncia ante una plataforma, esta debe tramitarla con mayor rapidez y atención que las presentadas por otros usuarios.

En teoría, esta categoría busca profesionalizar la detección de contenido ilegal y reducir los abusos del sistema de denuncias espontáneas. No obstante, en la práctica, puede convertirse en un canal privilegiado de influencia estatal o ideológica dentro del ecosistema digital. Si estas entidades son designadas sin criterios transparentes, o si responden a intereses políticos o institucionales, su poder puede ser usado para suprimir contenido disidente o crítico bajo el pretexto de combatir el odio o la desinformación. Esto concentra aún más el control de la narrativa pública en manos de un grupo reducido de actores con acceso directo a las plataformas, y aleja la moderación de contenidos del escrutinio ciudadano y del debate abierto.

El temor a sanciones que pueden alcanzar el 6% de la facturación global genera un efecto colateral peligroso: la sobremoderación. Plataformas como Facebook y YouTube ya han comenzado a eliminar preventivamente contenidos que podrían generar conflicto con las autoridades europeas, aunque sean legales o legítimos. En este nuevo marco, incluso expresiones protegidas por la legislación nacional o por tratados internacionales de derechos humanos pueden ser censuradas por precaución. Esta reacción no solo afecta la libertad de los usuarios, sino que configura una nueva arquitectura del discurso digital: más controlada, más temerosa, menos diversa. La voz del ciudadano común queda subordinada al criterio de entidades seleccionadas desde arriba, en un modelo que privilegia el consenso institucional por encima del pluralismo democrático.

Los medios de comunicación, especialmente aquellos que no pertenecen al núcleo tradicional o corporativo, se ven también gravemente perjudicados. Mientras que los grandes conglomerados gozan de canales de diálogo privilegiados con los reguladores y las instituciones europeas, los medios independientes, críticos o alternativos quedan a merced de algoritmos opacos y decisiones administrativas que determinan qué voces merecen mayor visibilidad en el ecosistema digital. Las plataformas, siguiendo las directrices de la DSA y de códigos de conducta como el Código de Buenas Prácticas contra la Desinformación, han comenzado a etiquetar y jerarquizar las fuentes informativas en función de su alineamiento con los discursos considerados institucionalmente legítimos.

Esta clasificación da lugar a una jerarquía de fuentes «confiables», donde el acceso a la audiencia no se gana por la calidad periodística, el rigor investigativo o la pluralidad de puntos de vista, sino por la cercanía a los marcos narrativos aceptados por la Comisión Europea y sus organismos asociados. Los medios que cuestionan políticas públicas —por ejemplo, las relacionadas con la gestión de la pandemia, las campañas de vacunación, o los conflictos internacionales— corren el riesgo de ser etiquetados como “potencialmente desinformativos”, incluso si sus contenidos no violan ninguna ley ni incurren en falsedad manifiesta. Esta etiqueta, visible o invisible, reduce su alcance, limita su circulación en redes sociales, y afecta su posicionamiento en los motores de búsqueda y recomendaciones automatizadas.

Las plataformas, incentivadas por la amenaza de sanciones y guiadas por auditorías periódicas impuestas por la DSA, prefieren dar visibilidad a medios reconocidos por los reguladores como socios “fiables”. Esto ha creado un círculo cerrado de legitimidad, donde medios corporativos de gran escala, agencias oficiales o redes periodísticas asociadas a iniciativas gubernamentales dominan la narrativa pública, mientras otras voces son empujadas hacia la marginalidad digital. En lugar de fomentar la competencia informativa y el contraste de perspectivas, el ecosistema digital europeo empieza a parecerse a un espacio curado institucionalmente, donde lo que se considera «verdad» es definido desde el poder.

El resultado es una preocupante reducción del pluralismo mediático, un fenómeno incompatible con una democracia robusta. El derecho de la ciudadanía a acceder a una diversidad de fuentes y opiniones, incluso incómodas o minoritarias, se ve restringido en favor de una lógica de validación jerárquica. Esta tendencia no solo empobrece el debate público, sino que mina la confianza en los medios y favorece la radicalización en espacios alternativos, lo que a la larga perjudica la misma cohesión social que la DSA dice proteger.

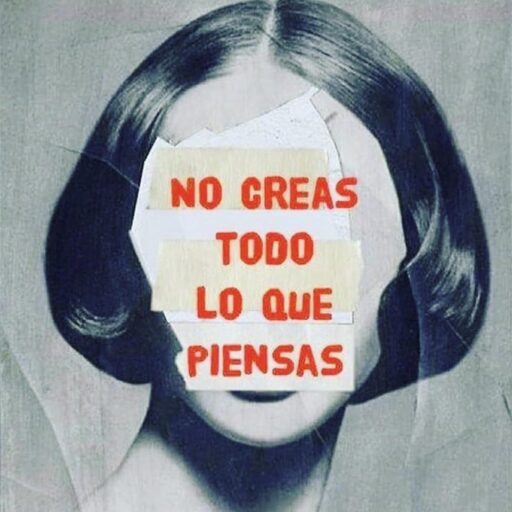

Los usuarios, finalmente, son los grandes perdedores en este nuevo paradigma. A menudo sin saberlo, pueden ver sus publicaciones despriorizadas, ocultas o eliminadas, incluso si no infringen ninguna ley. Los mecanismos de apelación son complejos, poco accesibles, y muchas veces controlados por sistemas automatizados. La combinación de censura algorítmica, normas ambiguas y miedo a represalias genera una atmósfera de autocensura donde los ciudadanos prefieren callar antes que arriesgarse. Esto es especialmente preocupante en áreas sensibles como la religión, la política exterior o la crítica a las instituciones, donde la libertad de conciencia y expresión deberían ser más protegidas, no menos.

El discurso sanitario no es el único que se ve afectado. Durante la guerra en Ucrania, la DSA fue utilizada para justificar el bloqueo de medios rusos como RT y Sputnik. Asimismo, se han activado mecanismos similares para monitorear contenidos vinculados al conflicto en Gaza. Aunque la lucha contra la desinformación extranjera es legítima, utilizar esta ley para cerrar el acceso a voces disidentes o para controlar el relato oficial de una guerra roza el autoritarismo comunicacional. Organizaciones como Access Now y el Atlantic Council han expresado su preocupación por el uso discrecional de estos poderes y por la falta de criterios jurídicos claros en la toma de decisiones.

Legalmente, la DSA pretende estar alineada con sentencias del Tribunal Europeo de Derechos Humanos, que exigen proporcionalidad en las restricciones a la libertad de expresión. Sin embargo, en su ejecución concreta, muchas de las medidas carecen de supervisión judicial directa, se aplican de forma automatizada y permiten sancionar sin que el afectado tenga una defensa efectiva. Organismos como Human Rights Watch, Amnistía Internacional y la Electronic Frontier Foundation han advertido sobre estos riesgos, señalando la necesidad de garantizar procedimientos transparentes y respetuosos de los derechos humanos, lo cual aún está lejos de cumplirse.

Lejos de proteger la democracia, la DSA corre el riesgo de vaciarla de contenido sustantivo. La ciudadanía necesita un entorno digital que fomente el debate, permita disentir y proteja el pensamiento crítico. En su forma actual, esta ley consagra un modelo tecnocrático y centralizado de control del discurso, que erosiona la autonomía de las plataformas, silencia a los medios independientes y deja al ciudadano como sujeto pasivo de una comunicación institucionalizada. El pluralismo, la crítica, el debate y la duda razonable no son amenazas, sino fundamentos de la libertad.

Europa debe defender sus principios no sólo en el papel, sino también en la práctica. La protección digital no puede convertirse en una excusa para imponer una única versión de la realidad. Si la DSA no se revisa con seriedad y transparencia, el precio que se pagará será la lenta desaparición de la democracia que dice proteger.