La aprobación de la Online Safety Act en el Reino Unido marca un punto de inflexión en la regulación de internet en Europa. Presentada como una herramienta para proteger a los usuarios —especialmente a los menores— frente a contenidos dañinos, la ley ha abierto un debate de fondo: hasta qué punto la seguridad digital puede justificar nuevas formas de control sobre lo que se dice y circula en la red.

El texto, impulsado por el UK Government y aprobado por el UK Parliament en 2023, establece un nuevo marco de obligaciones para las grandes plataformas digitales. Redes sociales, motores de búsqueda y servicios de mensajería deberán identificar, evaluar y mitigar los riesgos asociados a los contenidos que alojan. No se trata solo de eliminar material ilegal —como terrorismo o explotación infantil— sino también de actuar frente a contenidos considerados “perjudiciales”, una categoría más difusa y, precisamente por eso, más polémica.

El contexto ayuda a entender por qué esta ley ha salido adelante. Durante años, gobiernos europeos han observado con creciente inquietud la capacidad de las grandes tecnológicas para amplificar desinformación, discursos de odio o dinámicas de acoso masivo. Casos de radicalización online, campañas coordinadas o exposición de menores a contenidos inapropiados han alimentado la presión política para intervenir. En ese sentido, la Online Safety Act no es una anomalía, sino parte de una tendencia más amplia que también se refleja en iniciativas de la Unión Europea como la Digital Services Act.

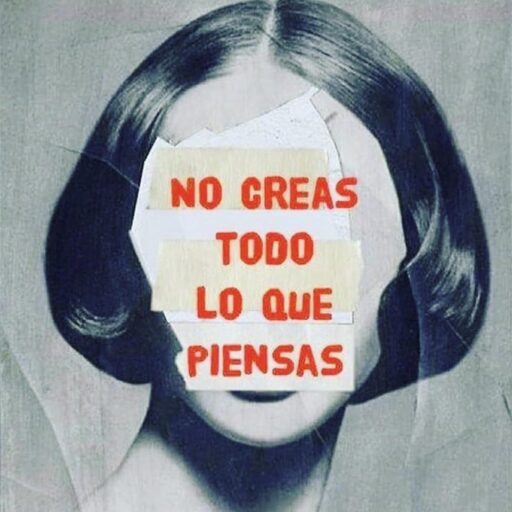

Sin embargo, es en los matices donde emerge la controversia. La ley no solo obliga a retirar contenidos ilegales —algo relativamente consensuado— sino que introduce el deber de gestionar aquellos que, sin ser ilícitos, puedan considerarse dañinos. Aquí es donde el terreno se vuelve resbaladizo. ¿Qué es exactamente un contenido perjudicial? ¿Quién define ese umbral? ¿Con qué criterios se decide qué debe limitarse y qué no?

Los críticos sostienen que este tipo de formulaciones abre la puerta a una moderación preventiva, donde las plataformas, para evitar sanciones, opten por eliminar o limitar cualquier contenido que pueda generar dudas. El resultado, advierten, podría ser un ecosistema más controlado, pero también más homogéneo y menos abierto al disenso. No se trata necesariamente de censura directa, sino del desplazamiento del riesgo hacia quienes publican.

Desde el otro lado, los defensores de la ley argumentan que la ausencia de regulación ha generado un entorno donde los daños son reales y medibles. Sostienen que la libertad de expresión no puede desvincularse de sus consecuencias, especialmente cuando se trata de entornos digitales capaces de amplificar mensajes a escala masiva. En este enfoque, la intervención no es una amenaza, sino una corrección necesaria.

Ahí es donde realmente está el debate. La Online Safety Act no elimina el choque entre seguridad y libertad; más bien lo convierte en norma. Por un lado, fija reglas más claras. Por otro, concentra más poder en manos de los reguladores y de las propias plataformas, que pasan a tener un peso todavía mayor a la hora de decidir hasta dónde llega —y dónde se corta— lo que se puede decir en el espacio público.