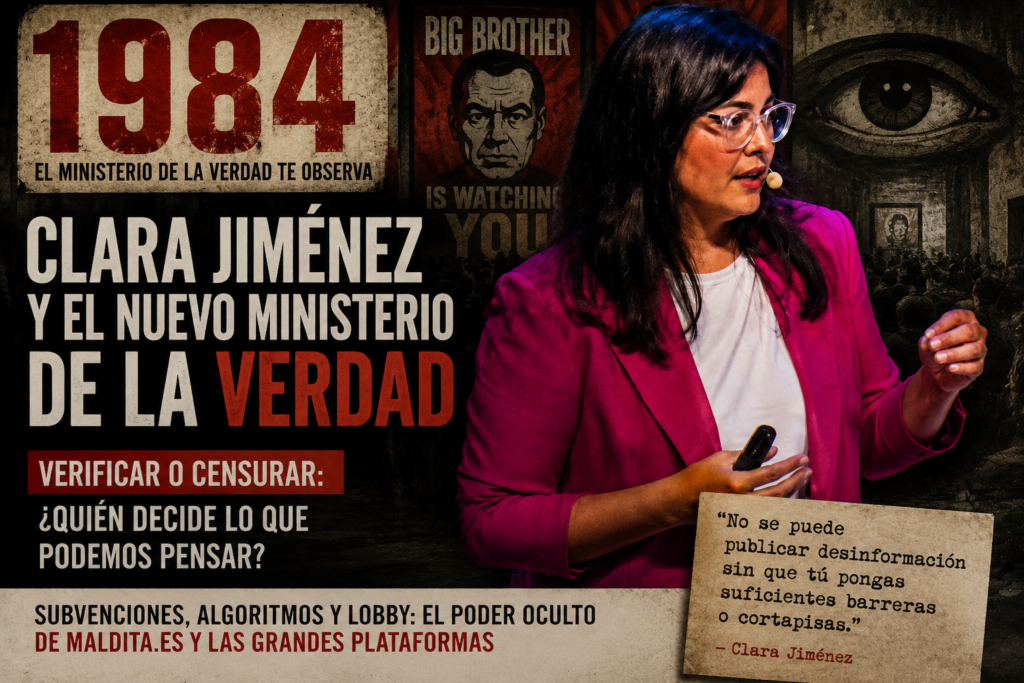

La conferencia de Clara Jiménez en Bilbao defiende que la desinformación erosiona la democracia y exige más responsabilidad de plataformas, verificadores y reguladores. Pero su intervención abre una pregunta que cualquier sociedad debe responder: quién decide cuándo proteger al ciudadano y cuándo empezar a tutelar lo que puede ver, compartir o creer.

La intervención de Clara Jiménez Cruz sitúa la DANA de Valencia de 2024 y la pandemia como ejemplos de vacíos de información rellenados por bulos, mentiras políticas y teorías de la conspiración. En su relato, lo ocurrido en Valencia no fue solo un episodio caótico, sino la demostración de que la desinformación organizada destruye confianza y debilita el sistema democrático. Se conecta con la experiencia de que cuando falta información fiable, crece la ansiedad y circulan respuestas dudosas con apariencia de certeza.

A partir de ahí, Jiménez presenta a la Fundación Maldita.es como una estructura que combina periodismo, tecnología, educación e incidencia pública. No solo explica que verifican contenidos, también afirma que hacen alfabetización mediática, desarrollan herramientas tecnológicas y trabajan en políticas públicas. En un momento especialmente relevante, lo resume sin rodeos: “hacemos lobby”, con la idea de que las decisiones institucionales sobre desinformación se tomen “con evidencia y no solamente con política”. Ese detalle importa porque desplaza a la organización del terreno exclusivamente periodístico al de la influencia regulatoria.

“Respondemos con periodismo basado en datos y en hechos, aportando la evidencia para que sean los lectores, la ciudadanía, quienes determinen si una cosa es verdadera o falsa.” — Clara Jiménez, aprox. 10:30–10:48.

Esa cita resume al ponente no como soberana de la verdad, sino como mediadora que aporta pruebas. Sin embargo, el problema empieza precisamente ahí. En el ecosistema digital actual, informar no siempre significa solo informar: también puede significar etiquetar, reducir distribución, modular recomendaciones o influir en los criterios con los que grandes plataformas gestionan la visibilidad. Y eso ya no es una mera conversación periodística; es una intervención sobre la circulación efectiva del discurso público.

De hecho, la propia ponente reconoce que la colaboración con plataformas no equivale necesariamente a borrar contenidos. Cuando explica el sistema de terceros verificadores, habla de alertar al usuario, “que no borrar”. Pero el matiz no elimina el fondo del debate. Los documentos oficiales de la compañía muestran que los contenidos calificados como falsos se acompañaban de etiquetas y sufrían reducción de distribución; además, en la UE, el informe de Meta para el primer semestre de 2024 sostiene que más de 30 millones de piezas de contenido en Facebook y más de 990.000 en Instagram fueron tratadas con verificaciones apoyadas en trabajo de terceros. No es una supresión judicial del discurso, pero sí una alteración relevante de su alcance.

En enero de 2025, la propia Meta anunció el final del programa de verificación por terceros en Estados Unidos y admitió que un sistema pensado para informar había acabado, según sus palabras, convirtiéndose demasiado a menudo en una herramienta para censurar. Aunque la decisión se anunció para el mercado estadounidense y no prueba por sí sola que todo el modelo de verificación sea ilegítimo, sí demuestra que la objeción sobre el riesgo de sobreactuación no es una paranoia de “antisistema”: está reconocida por una de las plataformas que mejor conoce sus efectos de producto y de distribución.

Por otra parte, el artículo 20 de la Constitución española protege tanto la libertad de expresión como el derecho a comunicar o recibir información veraz, y además establece que el ejercicio de esos derechos no puede restringirse mediante censura previa. Esa triple combinación importa mucho. El debate no puede despacharse diciendo solo “todo vale” ni, en el extremo contrario, “solo debe circular lo que pase por filtros expertos”. La tensión constitucional real está entre libertad, veracidad y ausencia de censura previa.

La DSA europea se mueve en ese terreno ambiguo. Por un lado, refuerza derechos del usuario al exigir transparencia cuando una plataforma elimina o suspende contenidos, prevé mecanismos de recurso y facilita la notificación de contenido ilegal. Por otro, obliga a las grandes plataformas a mitigar riesgos sistémicos, incluidos los ligados a desinformación y manipulación. Además, la propia Comisión subraya que el Código de Conducta sobre Desinformación debe combatir esos riesgos “manteniendo plenamente” la libertad de expresión. Y los trusted flaggers, conviene recordarlo, solo notifican contenido potencialmente ilegal; la decisión final sigue en manos de la plataforma. No hay, por tanto, un “ministerio de la verdad” formalizado en la letra de la norma. Pero sí existe un entramado regulatorio y privado que puede empujar hacia formas de intervención opacas o excesivas sobre la visibilidad del discurso.

“Libertad de expresión para la ciudadanía para decir lo que quiera en redes sociales, pero no un algoritmo que potencie las mentiras.” — Clara Jiménez, aprox. 25:58–26:08.

Esa frase es probablemente el núcleo más importante de la conferencia, y también el punto donde una crítica liberal tiene más filo. Porque la discusión ya no es sobre si un ciudadano puede hablar, sino sobre quién decide qué empujan los algoritmos, con qué criterios, a partir de qué indicadores y bajo qué supervisión. Eso no equivale automáticamente a censura, pero tampoco es neutralidad. Es gobierno de la atención.

Hay, además, como critica, la conferencia dedica mucho más desarrollo a actores externos, a la influencia de Rusia o al retorno de Donald Trump que a ejemplos concretos del deterioro informativo dentro de España. En preguntas del público, Jiménez dice que existen “fuerzas en España políticas y sociales” que erosionan el sistema, pero no ofrece nombres ni casos específicos porque, afirma, no dispone de pruebas “judiciales” para hacerlo. Esa cautela evita la acusación gratuita; al mismo tiempo, deja un vacío para quien esperaba un diagnóstico más pegado al terreno doméstico. Es aceptable que tenga estas sospechas, pero cuestionable que preste tan poca atención a la realidad española.

También la parte tecnológica exige matiz. La conferencia sostiene que Google y YouTube están retirando frenos frente a la desinformación. Google ha comenzado a retirar gradualmente el soporte del marcado ClaimReview en la Búsqueda, aunque lo mantiene en Fact Check Explorer; y sus propios informes del Código europeo muestran que esos rich snippets alcanzaron 120.339.655 impresiones en la UE en el primer semestre de 2024. YouTube, por su parte, retiró en enero de 2025 los últimos restos de su política específica de COVID para integrarlos en una política médica más amplia, pero sigue prohibiendo contenidos que contradicen orientaciones sanitarias con riesgo grave y mantiene políticas contra la desinformación electoral. Es decir, no estamos ante un paso limpio del control total a la barra libre, sino ante un reajuste contradictorio y cambiante de herramientas, etiquetas y prioridades.

En una democracia madura, ni una plataforma, ni un gobierno, ni una fundación verificadora deberían poder presentarse como árbitro final de la verdad. Pero una sociedad abierta tampoco puede conformarse con algoritmos opacos que premian lo más viral sin rendición de cuentas. La salida no está en elegir entre tutela y caos, sino en exigir pluralismo, reglas transparentes, posibilidad real de recurso, humildad institucional y el mismo escrutinio para para quien desinforma, para quien modera y también para quien verifica. Solo así la defensa de la verdad no acaba debilitando la libertad que pretende proteger.

Fuente:

https://youtu.be/MBerVkqVtG4?is=oTXoAjtYspelwTkS